Системы на нейронных сетях с обратными связями

Можно сопоставить динамику сети Хопфилда с динамикой шарика, движущегося с трением в сложном рельефе (рис. 9.6). Если шарик имеет малую энергию, он может не достичь максимальной впадины, оставшись в углублении, дно которого выше. Аналогично сеть Хопфилда при обучении в некоторых случаях может не достигнуть минимальной ошибки. В минимумах функции энергии — устойчивые состояния сети, а на ее… Читать ещё >

Системы на нейронных сетях с обратными связями (реферат, курсовая, диплом, контрольная)

Прямонаправленные сети, будучи обученными, выдают ответ сразу после прохождения через них входного сигнала. Каждый нейрон срабатывает лишь однажды. Глубокая многостадийная обработка данных требует многих слоев и усложнений обучения. Рекуррентные сети обобщают такие однопроходные схемы. Выходы их возвращаются на входы, и информация пропускается многократно. Отсюда новое качество — динамическое обучение и обработка данных.

В 1982 г. Дж. Хопфилд, специалист в области физики твердого тела, выявил аналогию между нейронными сетями с симметричными связями и физическими объектами — спиновыми стеклами. На основе этой гипотезы он разработал теоретические основы нового типа НС с обратными связями, которая получила название «сеть Хопфилда». Эти сети успешно исследовались методами теоретической физики (статистической механики). Кроме того, они имели регулярную структуру и могли быть просто реализованы аппаратно [7, 12].

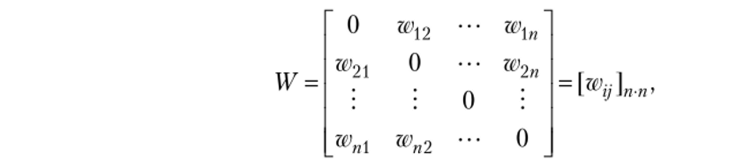

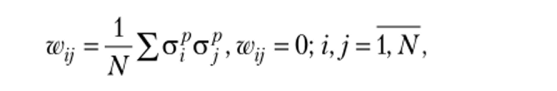

Матрица связей W в сети Хопфилда — полная и симметричная с нулевой диагональю, т. е.

где Wjj = Wji и = 0.

В связи с этим сети Хопфилда имеют очень простую структуру (рис. 9.5). Каждый i-й нейрон соединяется прямыми и обратными связями с каждым (i — 1)-м нейроном (сплошные линии), а также — с (i + 1)-м нейроном (штриховые линии).

Рис. 9.5. Сеть Хонфилда.

Такая сеть может использоваться в нескольких вариантах.

- 1. Асинхронный вариант. Нейроны могут принимать два состояния: s е е {-1; +1}. В дискретные моменты времени t = 1, 2, … случайным образом выбирается &-й нейрон, для которого выполняется значение потенциала uk = HwjfjSj. При выполнении условия uksk < 0 состояние нейрона меняется на противоположное, т. е. sk —> ~sk.

- 2. Последовательный вариант. Перебор нейронов производится не случайно, а циклически, но в каждый момент t может меняться лишь состояние одного нейрона.

- 3. Параллельный вариант. Одновременно изменяется состояние тех нейронов, для которых выполняется условие uksk < 0. Синхронизация моментов обновления состояний нейронов делает такую динамику подверженной «зацикливанию».

В отличие от персептронов с пространственно разделенными входами и выходами, в сети Хонфилда все нейроны могут иметь и входы, и выходы. Вход в сети задается начальной конфигурацией активных нейронов. Выход сети определяется конечной стационарной конфигурацией активных нейронов.

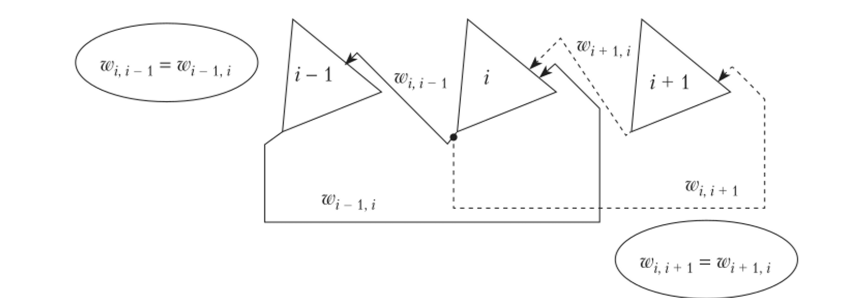

Можно показать, что асинхронная динамика сети сопровождается уменьшением энергии, определяемой как.

При изменении состояния одного k-то нейрона его вклад в Е изменяется с Ek(t) = -Sk^WfoSAt) = -sk(t)uk(t) на Ek(t + 1) = ~sk(t + 1 )uk(t). Следова;

тельно, Ek(t + 1) < Ek(t) = ~sk(t)uk(t).

Поскольку число нейронов конечно, Е ограничена снизу. Это означает, что эволюция состояния должна закончиться в локальном стационарном состоянии с min Е.

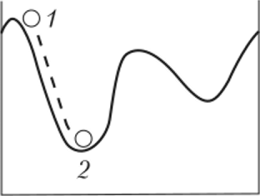

Можно сопоставить динамику сети Хопфилда с динамикой шарика, движущегося с трением в сложном рельефе (рис. 9.6). Если шарик имеет малую энергию, он может не достичь максимальной впадины, оставшись в углублении, дно которого выше. Аналогично сеть Хопфилда при обучении в некоторых случаях может не достигнуть минимальной ошибки.

Рис. 9.6. Динамика сети:

1 — начальное состояние; 2 — конечное состояние.

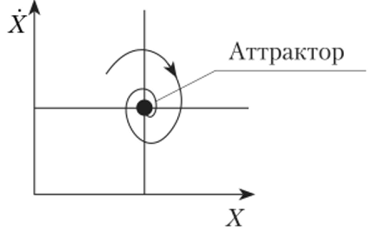

Рис. 9.7. Устойчивое состояние.

В минимумах функции энергии — устойчивые состояния сети, а на ее склонах — переходные состояния. Такая динамика определяет главное свойство сети Хопфилда — способность восстанавливать возмущенные состояния, т. е. вспоминать потерянную информацию (частично). Воспоминания по ассоциации — свойство ассоциативной памяти.

Стационарные состояния сети Хопфилда определяются положением аттракторов бассейна притяжения (рис. 9.7). Если начальная конфигурация s мало отличается от одного из аттракторов $*, т. е. |s-s*| «N, то сеть быстро эволюционирует к этому аттрактору, изменив состояния небольшого числа нейронов (s —> s*). Можно сказать, что состояние s содержит неполную информацию, которая, однако, достаточна для восстановления полной информации, кодируемой состоянием s*. Например, сеть может восстановить название запомненного имени по неполному набору символов.

Память, в которой информация ищется не, но адресу, а по частичной информации о содержании, называется контекстно-адресуемой, или ассоциативной, памятью. Важным ее свойством является распределенное кодирование состоянии, когда все нейроны сети участвуют в кодировании всех состояний памяти. Это сильно повышает устойчивость к помехам.

Для обучения сети Хопфилда можно использовать правило Хебба и вычислять веса связей по формуле

где р = 1,…, Р — число примеров; о/; — вектор, кодирующий образ: а? = [af ]N.

Это правило гарантирует стационарность произвольно выбранных векторов а/; в случае, когда их число Р = 0,05ЛГ. При больших значениях Р некоторые из запомненных ор теряют свойство стационарности. А при Р = 0,14N стационарное состояние сети теряет всякую связь с ор, и сеть переходит из режима запоминания в режим с большим числом аттракторов, далеких от запомненных gp.

Аттракторы, не совпадающие с gp, называются ложной памятью. Однако это тоже можно считать замечательным свойством сети Хопфилда, определяющим ее способность к синтезу новых образов. Такая сеть может активно преобразовывать информацию, а не только пассивно ее хранить.

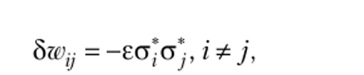

Существует специальная процедура уменьшения доступа к ложной памяти — разобучение. Она применяется к обученной сети и предполагает многократное представление сети в качестве начальных состояний, случайно генерируемых векторов (образов) и прослеживание их эволюции вплоть до стационарного состояния а*, которое может принадлежать как истинной, так и ложной памяти. После этого связи в сети модифицируются согласно выражению

где? > 0 — небольшая константа.

Такая процедура приводит к выравниванию доступности состояний истинных образов и снижению доступности состояний ложных образов (ложные состояния «закапываются»).

Разобучением можно увеличить емкость памяти с Р= 0,14Адо Р= N.

Сети Хопфилда применяются как ассоциативная память (для распознавания образов, прогнозирования во временных рядах и др.), для кластеризации данных (при предварительной обработке данных) и оптимизации (движения транспорта, потоков информации и пр.).

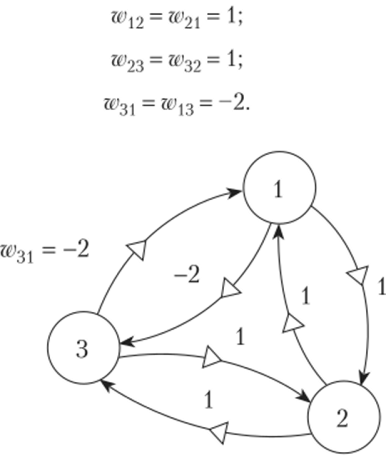

Пример простейшей сети Хопфилда Рассмотрим полносвязную сеть Хопфилда из трех нейронов с бинарными входами и выходами и целочисленными весами (рис. 9.8). Веса фиксированы при обучении и имеют следующие симметричные значения:

Рис. 9.8. Пример сети.

Состояние сети в любой момент времени задается вектором выходов узлов (лг, х2, х3). Предположим, что сеть стартует из некоторого начального состояния, случайно выбирает узел j и корректирует его выход (запускает при х-. = 1).

з Активностьу-го узла оценивается обычным образом: и} =? wjtx,? Выход узла равен.

i=i.

«1», если Uj > 0 и «О» — иначе. Далее выбираем и запускаем случайно новый узел, и так делаем много шагов (асинхронный режим работы). Так можно оценить для каждого состояния узла следующее состояние при запускании. Полученные состояния сведены в табл. 9.1.

Состояния сети.

Таблица 9.1

S | Состояние. | Новые состояния (после запускания). | |||||

Вектор | |||||||

*1. | х2 | *3. | Узел 1. | Узел 2. | Узел 3. | ||

б**. | |||||||

б. | |||||||

5*. | |||||||

Пример расчета: старт с s = 1; {О О 1}, запускаем Узел 1, тогда и{ = -2 • 1 + 0 = -2 < 0. Значит, выход г/3 = 1, хх = 0 и новое состояние — {0 0 1} и s = 1.

Запускаем Узел 2: и2 = 0 + 1 > 0. Значит, х2= 1 и s = 3 {0 1 1}.

Запускаем Узел З: и3 = 0 + 0 = 0. Значит, х3 = 1 и s = 1 {0 0 1}.

Анализ поведения сети позволяет утверждать, что начальное состояние старта безразлично, и сеть всегда приходит в состояния 5 = 3 и s = 6. Поскольку сеть всегда старается остаться в состояниях s = 3 и s = 6, они являются стабильными состояниями, которые сеть запомнила.

Сети Хопфилда отличаются однородностью, что позволяет упростить их аппаратную реализацию. Поэтому они часто используются в виде аппаратных приставок (спецпроцессоров) в нейрокомпьютерах.